人工智能算法在汽车软件中的功能安全设计方法——以上海控安实践为例

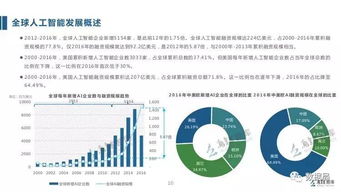

随着智能网联汽车的飞速发展,人工智能算法已成为实现高级驾驶辅助系统(ADAS)和自动驾驶(AD)功能的核心技术。将AI算法,特别是基于数据驱动的深度学习模型,集成到对安全性要求极高的汽车软件中,带来了前所未有的功能安全挑战。上海控安作为国内汽车软件安全领域的领先者,积极探索并实践了一套将人工智能算法运用于汽车软件的功能安全设计方法,为AI应用软件的可靠开发提供了系统性框架。

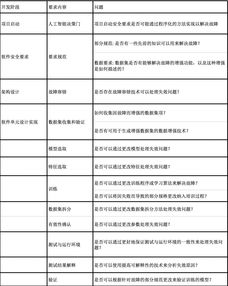

一、AI算法引入的独特安全挑战

与传统基于确定规则的汽车软件不同,AI算法,尤其是神经网络,具有“黑盒”特性、数据依赖性、非确定性输出以及难以进行形式化验证等特点。这使得其难以直接符合ISO 26262等现有功能安全标准对“免于系统性故障”和“可控性”的严格要求。具体挑战包括:模型训练数据的完备性与代表性不足、算法在未知场景(Corner Cases)下的行为不可预测、模型可能存在的脆弱性(如对抗样本攻击),以及软件生命周期中模型更新带来的一致性问题。

二、上海控安的功能安全设计方法体系

针对上述挑战,上海控安提出并实践了一套覆盖全生命周期的“纵深防御”设计方法,其核心在于将功能安全理念与AI开发流程深度融合。

- 安全目标与危害分析前移:在AI功能定义阶段,即开展基于场景的深入危害分析与风险评估(HARA)。不仅考虑传统失效,更重点分析因AI性能局限(如感知误判、决策歧义)可能导致的危害,并据此定义明确、可量化的功能安全目标(如目标检测的精确率/召回率要求、决策置信度阈值)。

- 数据与模型开发的安全考量:

- 数据安全生命周期:建立涵盖数据采集、标注、清洗、增强、版本管理的安全流程。确保训练数据集对目标运行设计域(ODD)的充分覆盖,并对数据偏差和潜在偏见进行识别与缓解。

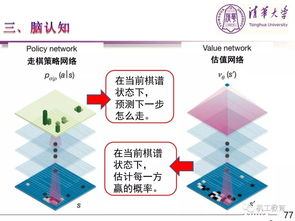

- 安全导向的模型设计:在模型架构设计时,融入可解释性(XAI)和不确定性量化(如贝叶斯神经网络、蒙特卡洛Dropout)机制,使模型能输出决策的置信度。采用对抗训练等技术提升模型鲁棒性。

- 严格的安全验证与确认(V&V):构建多层级的测试体系。包括:基于仿真和实车的大量场景测试,特别是极端和边缘场景;针对模型的独立安全测试(如神经元覆盖率测试、对抗样本测试);以及将AI组件作为整体系统一部分,进行集成测试和系统测试,验证其安全目标达成情况。

- 运行时安全监控与冗余设计:承认AI算法无法达到100%可靠,因此在系统架构层面设计安全冗余。

- AI功能安全监控器:开发独立的“安全封装”层或监控模块,实时监测AI输出的合理性、置信度以及系统运行状态。当检测到异常(如置信度过低、输出超出合理范围、与冗余传感器信息冲突)时,能触发降级或安全接管策略(如提醒驾驶员介入、执行最小风险 maneuver)。

- 异构冗余:在关键功能路径上,采用不同技术原理(如规则系统、传统计算机视觉、不同架构的AI模型)进行冗余计算与交叉验证,以降低共性原因失效的风险。

- 持续安全与生命周期管理:建立模型持续学习与更新的安全管理流程。任何模型更新都需经过完整的再验证与再确认,确保安全性能不退化。通过车云协同,收集实际运行中的长尾场景数据,用于改进模型,形成安全性能持续提升的闭环。

三、AI应用软件开发的工程化实践

在上海控安的实践中,上述方法被具化为可操作的工程实践。例如,将安全需求逐层分解至AI软件组件;在MIL/SIL/HIL各阶段融入针对AI的测试;利用形式化方法对AI组件的接口和部分逻辑进行规约与验证;开发专用的工具链支持AI模型的安全分析、测试用例生成与覆盖率评估。

四、展望与

将人工智能算法安全地集成到汽车软件中是一项系统工程,无法仅靠改进算法本身解决。上海控安所倡导和实践的方法,核心在于构建一个从安全文化、流程、技术到工具的完整体系,在拥抱AI强大能力的通过系统性的设计确保其行为在安全边界之内。随着ISO 21448(SOTIF)等新标准对预期功能安全的关注,以及未来可能的AI专用安全标准的出现,这套融合了功能安全与AI工程的方法论将愈发重要,为汽车产业安全、可靠地迈向高度智能化保驾护航。

如若转载,请注明出处:http://www.zxbdpd.com/product/2.html

更新时间:2026-04-20 10:11:15